无原创,纯转发

GitHub Agentic Workflows:用自然语言写 GitHub Actions 的“智能工作流”

GitHub 开源项目 gh-aw(GitHub Agentic Workflows),主打一个思路:用自然语言 Markdown 编写“代理式(agentic)工作流”,然后直接在 GitHub Actions 里运行,让 AI 代你完成仓库中的重复性任务。

它提供的核心价值包括:

• 更低门槛的工作流编写方式:用 Markdown 描述要做什么,而不是从零写复杂的 YAML/脚本

• 更强调安全的执行模型(Guardrails):默认只读权限;写入操作需要通过经过清洗的

• 完善的文档与上手路径:官方提供 Quick Start 与完整文档,方便快速跑通示例并理解整体机制

• 生态配套:

• AWF(Agent Workflow Firewall):限制与记录代理的网络访问(出站控制)

• MCP Gateway:统一转发 MCP(Model Context Protocol)服务调用,便于集中管理访问

适合关注 AI + DevOps、希望把“AI 介入仓库日常操作”做得更可控、更工程化的团队参考与尝试(同时也要保持必要的人类监督)。

原链接:https://github.com/github/gh-aw

#GitHubActions #AI自动化 #工作流 #安全工程 #开源项目

GitHub 开源项目 gh-aw(GitHub Agentic Workflows),主打一个思路:用自然语言 Markdown 编写“代理式(agentic)工作流”,然后直接在 GitHub Actions 里运行,让 AI 代你完成仓库中的重复性任务。

它提供的核心价值包括:

• 更低门槛的工作流编写方式:用 Markdown 描述要做什么,而不是从零写复杂的 YAML/脚本

• 更强调安全的执行模型(Guardrails):默认只读权限;写入操作需要通过经过清洗的

safe-outputs;并配套多层防护(输入净化、工具白名单、编译期校验、网络隔离、供应链安全等)• 完善的文档与上手路径:官方提供 Quick Start 与完整文档,方便快速跑通示例并理解整体机制

• 生态配套:

• AWF(Agent Workflow Firewall):限制与记录代理的网络访问(出站控制)

• MCP Gateway:统一转发 MCP(Model Context Protocol)服务调用,便于集中管理访问

适合关注 AI + DevOps、希望把“AI 介入仓库日常操作”做得更可控、更工程化的团队参考与尝试(同时也要保持必要的人类监督)。

原链接:https://github.com/github/gh-aw

#GitHubActions #AI自动化 #工作流 #安全工程 #开源项目

Entire:把 AI 编程对话“写进”每一次 Git 提交

用 AI 写代码时,最容易丢的不是代码,而是“为什么这么写”的上下文。Entire 提供一个思路:在你正常的 git 工作流里,把每次 AI agent 会话自动记录下来,并与对应的 commit 绑定,形成可搜索的历史记录。

它能做什么?

• 自动捕获会话:在每次 push 时记录 AI agent 的会话内容,并和提交一起关联。

• 不改变你的工作方式:通过 CLI 接入现有工具链,尽量减少上下文切换。

• 支持多种 agent:目前支持 Claude Code、Google Gemini;OpenAI Codex 等集成在路上。

• 把“意图”留在仓库里:官方强调记录会直接存进 git 历史,不依赖额外托管服务或外部数据库。

安装方式(官网给出的命令)

•

适合希望团队更容易复盘决策、追踪 AI 产出过程、减少重复踩坑的工程项目。

原链接:http://entire.io/

#Git #AI编程 #开发工具 #工程效率 #CLI

用 AI 写代码时,最容易丢的不是代码,而是“为什么这么写”的上下文。Entire 提供一个思路:在你正常的 git 工作流里,把每次 AI agent 会话自动记录下来,并与对应的 commit 绑定,形成可搜索的历史记录。

它能做什么?

• 自动捕获会话:在每次 push 时记录 AI agent 的会话内容,并和提交一起关联。

• 不改变你的工作方式:通过 CLI 接入现有工具链,尽量减少上下文切换。

• 支持多种 agent:目前支持 Claude Code、Google Gemini;OpenAI Codex 等集成在路上。

• 把“意图”留在仓库里:官方强调记录会直接存进 git 历史,不依赖额外托管服务或外部数据库。

安装方式(官网给出的命令)

•

curl -fsSL https://entire.io/install.sh | bash适合希望团队更容易复盘决策、追踪 AI 产出过程、减少重复踩坑的工程项目。

原链接:http://entire.io/

#Git #AI编程 #开发工具 #工程效率 #CLI

Stripe「Minions」:一键生成、端到端交付的无人值守编码代理

Stripe 在内部打造了一套名为 Minions 的编码代理:从接到任务到产出可评审的 PR,全程几乎无需人类介入。现在,Stripe 每周有超过 1000 个合并的 PR 是由 Minions 从头到尾生成的(人类负责 Review,但不写代码)。

为什么要自研?

在 Stripe 这种超大规模、强约束的工程环境里,“从零写个原型”和“在成熟巨型代码库里安全改动”完全不是一回事:

• 代码库规模巨大(数亿行),栈也相对小众:大量后端是 Ruby + Sorbet,还有大量 Stripe 自研库,LLM 天然不熟

• 业务风险极高:Stripe 的代码承载着 每年超过 1 万亿美元 的支付规模,并受金融合规与监管约束

• 既要让代理“会写”,也要让它“按规矩写、能跑通、能过 CI”,并与既有研发流程深度结合

工程师怎么用?

最常见的入口是 Slack:

• 在讨论线程里 @Slack App 就能发起 Minion,它会读取整个线程与相关链接作为上下文

• 也集成到内部系统里:文档平台、Feature Flag、工单系统等

例如 CI 发现 flaky tests,会生成工单,直接提供按钮让 Minion 去修

完成后,Minion 会:

• 创建分支 → 推送 → 跑 CI → 按模板生成 PR

如果效果不理想,人类可以补充指令让它再改;即使不完美,也常常是很好的“可用起点”。

Minions 背后怎么运作(要点版)

Stripe 的思路是:把“创意生成”交给 LLM,把“必须可靠执行的步骤”交给确定性工具链。

• 运行环境:在隔离的 devbox 中执行(10 秒内可启动,预热并预载代码与服务),与生产与公网隔离,便于并行

• Agent 框架:基于 Block 的开源编码代理 goose 的 fork,并做了强定制

• 规则与上下文:读取各类 agent rule 文件,但多为“按目录条件生效”,避免全局死规则拖累

• 工具调用:接入 MCP(函数调用通用协议),并建设内部 MCP 服务 Toolshed,提供 400+ 工具(文档、工单、构建状态、Sourcegraph 搜索等)

• 反馈与质量闸门:

• 首先跑本地启发式 lint/检查(通常 <5 秒)

• 再跑选择性的 CI(Stripe 有 300 万+ 测试),部分失败可自动修复

• 为控制成本与等待时间:最多两轮 CI,强调“能本地提前发现就不要拖到 CI”

接下来

这篇是系列 Part 1,主要讲“怎么用、能做什么”;Part 2 会深入实现细节。整体信号很明确:当“开发者注意力”成为稀缺资源时,无人值守、可并行的编码代理正在改变工程协作方式。

原文链接:https://stripe.dev/blog/minions-stripes-one-shot-end-to-end-coding-agents

#AI工程化 #编码代理 #开发者效率 #CI实践 #Stripe

Stripe 在内部打造了一套名为 Minions 的编码代理:从接到任务到产出可评审的 PR,全程几乎无需人类介入。现在,Stripe 每周有超过 1000 个合并的 PR 是由 Minions 从头到尾生成的(人类负责 Review,但不写代码)。

为什么要自研?

在 Stripe 这种超大规模、强约束的工程环境里,“从零写个原型”和“在成熟巨型代码库里安全改动”完全不是一回事:

• 代码库规模巨大(数亿行),栈也相对小众:大量后端是 Ruby + Sorbet,还有大量 Stripe 自研库,LLM 天然不熟

• 业务风险极高:Stripe 的代码承载着 每年超过 1 万亿美元 的支付规模,并受金融合规与监管约束

• 既要让代理“会写”,也要让它“按规矩写、能跑通、能过 CI”,并与既有研发流程深度结合

工程师怎么用?

最常见的入口是 Slack:

• 在讨论线程里 @Slack App 就能发起 Minion,它会读取整个线程与相关链接作为上下文

• 也集成到内部系统里:文档平台、Feature Flag、工单系统等

例如 CI 发现 flaky tests,会生成工单,直接提供按钮让 Minion 去修

完成后,Minion 会:

• 创建分支 → 推送 → 跑 CI → 按模板生成 PR

如果效果不理想,人类可以补充指令让它再改;即使不完美,也常常是很好的“可用起点”。

Minions 背后怎么运作(要点版)

Stripe 的思路是:把“创意生成”交给 LLM,把“必须可靠执行的步骤”交给确定性工具链。

• 运行环境:在隔离的 devbox 中执行(10 秒内可启动,预热并预载代码与服务),与生产与公网隔离,便于并行

• Agent 框架:基于 Block 的开源编码代理 goose 的 fork,并做了强定制

• 规则与上下文:读取各类 agent rule 文件,但多为“按目录条件生效”,避免全局死规则拖累

• 工具调用:接入 MCP(函数调用通用协议),并建设内部 MCP 服务 Toolshed,提供 400+ 工具(文档、工单、构建状态、Sourcegraph 搜索等)

• 反馈与质量闸门:

• 首先跑本地启发式 lint/检查(通常 <5 秒)

• 再跑选择性的 CI(Stripe 有 300 万+ 测试),部分失败可自动修复

• 为控制成本与等待时间:最多两轮 CI,强调“能本地提前发现就不要拖到 CI”

接下来

这篇是系列 Part 1,主要讲“怎么用、能做什么”;Part 2 会深入实现细节。整体信号很明确:当“开发者注意力”成为稀缺资源时,无人值守、可并行的编码代理正在改变工程协作方式。

原文链接:https://stripe.dev/blog/minions-stripes-one-shot-end-to-end-coding-agents

#AI工程化 #编码代理 #开发者效率 #CI实践 #Stripe

SQLite Vector:把向量检索带进 SQLite 的跨平台扩展

SQLite-Vector 是一个高性能、跨平台的 SQLite 扩展,让你在本地嵌入式数据库里直接做向量相似度检索,适合移动端/边缘侧的离线 AI 场景。

核心亮点

• 普通表就能用:不需要虚拟表,向量直接以

• 低门槛接入:无需漫长的预建索引流程,上手即用

• 性能优化:C 实现 + SIMD 加速,内置多种距离函数

• 低内存占用:默认约 30MB 内存开销

• 离线与隐私友好:数据留在本地,适合端侧语义搜索、推荐、图像检索等

支持能力一览

• 向量类型:Float32 / Float16 / BFloat16 / Int8 / UInt8 / 1Bit

• 距离度量:L2、Squared L2、L1、Cosine、Dot、Hamming(1bit)

• 量化与扫描:提供量化、预加载,以及

安装与生态

• 可从 GitHub Releases 下载各平台预编译二进制(Linux/macOS/Windows/Android/iOS)

• 提供 WASM 版本(npm:

• 也有 Swift Package / Android 依赖 / Python 包 等接入方式

使用与授权提醒

项目采用 Elastic License 2.0:通常允许在非生产环境使用、修改与分发;生产或托管服务用途需商业授权(详见仓库 License 说明)。

原链接:https://github.com/sqliteai/sqlite-vector

#SQLite #向量检索 #EdgeAI #本地AI #数据库扩展

SQLite-Vector 是一个高性能、跨平台的 SQLite 扩展,让你在本地嵌入式数据库里直接做向量相似度检索,适合移动端/边缘侧的离线 AI 场景。

核心亮点

• 普通表就能用:不需要虚拟表,向量直接以

BLOB 存在常规表字段里• 低门槛接入:无需漫长的预建索引流程,上手即用

• 性能优化:C 实现 + SIMD 加速,内置多种距离函数

• 低内存占用:默认约 30MB 内存开销

• 离线与隐私友好:数据留在本地,适合端侧语义搜索、推荐、图像检索等

支持能力一览

• 向量类型:Float32 / Float16 / BFloat16 / Int8 / UInt8 / 1Bit

• 距离度量:L2、Squared L2、L1、Cosine、Dot、Hamming(1bit)

• 量化与扫描:提供量化、预加载,以及

vector_quantize_scan 等查询接口(支持流式返回)安装与生态

• 可从 GitHub Releases 下载各平台预编译二进制(Linux/macOS/Windows/Android/iOS)

• 提供 WASM 版本(npm:

@sqliteai/sqlite-wasm)• 也有 Swift Package / Android 依赖 / Python 包 等接入方式

使用与授权提醒

项目采用 Elastic License 2.0:通常允许在非生产环境使用、修改与分发;生产或托管服务用途需商业授权(详见仓库 License 说明)。

原链接:https://github.com/sqliteai/sqlite-vector

#SQLite #向量检索 #EdgeAI #本地AI #数据库扩展

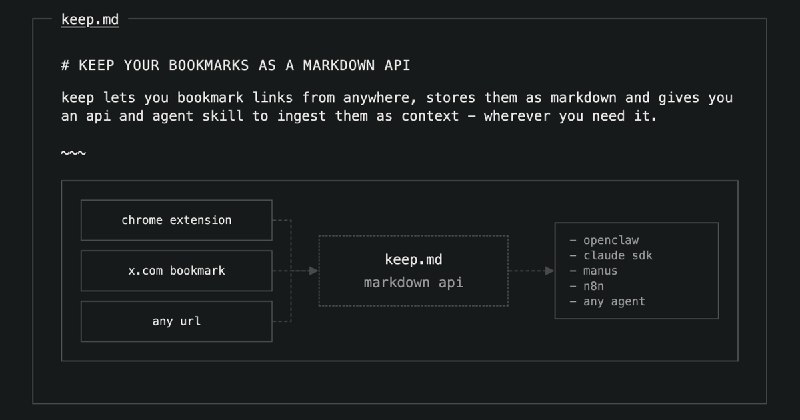

keep.md:把收藏夹变成「可被 AI 直接读取」的 Markdown API

keep.md 主打一个简单但实用的思路:把你在各处保存的链接,统一存成 Markdown,并提供 API + Agent 技能,让它们能随时被你的工作流或智能体当作上下文调用。

它适合这些场景:

• 你保存了一堆资料链接,希望 AI/Agent 能直接读懂内容并引用

• 你收藏了文档,想让 Agent 辅助写代码、查用法

• 你保留了长线程/讨论,希望 Agent 自动整理成摘要或草稿

工作方式也很直观:你保存链接 → 系统生成 Markdown → 你的 Agent 读取并使用。

目前提供 Chrome 扩展(页面显示仍在等待 Chrome 商店审核),并支持接入多种工具/平台(如 n8n、Claude SDK、各类 Agent 等)。

费用信息:免费档包含 50 条链接,付费计划 $10/月起。

原链接:https://keep.md/

#书签管理 #Markdown #API #AI工具 #Agent工作流

keep.md 主打一个简单但实用的思路:把你在各处保存的链接,统一存成 Markdown,并提供 API + Agent 技能,让它们能随时被你的工作流或智能体当作上下文调用。

它适合这些场景:

• 你保存了一堆资料链接,希望 AI/Agent 能直接读懂内容并引用

• 你收藏了文档,想让 Agent 辅助写代码、查用法

• 你保留了长线程/讨论,希望 Agent 自动整理成摘要或草稿

工作方式也很直观:你保存链接 → 系统生成 Markdown → 你的 Agent 读取并使用。

目前提供 Chrome 扩展(页面显示仍在等待 Chrome 商店审核),并支持接入多种工具/平台(如 n8n、Claude SDK、各类 Agent 等)。

费用信息:免费档包含 50 条链接,付费计划 $10/月起。

原链接:https://keep.md/

#书签管理 #Markdown #API #AI工具 #Agent工作流

WebClaw:OpenClaw 的轻量快速 Web 客户端(Beta)

WebClaw 是一个面向 OpenClaw 的快速 Web 客户端,主打轻量、上手快,适合想用浏览器直接连接 OpenClaw Gateway 的用户与开发者。目前项目处于 Beta 阶段。

你可以用它做什么

• 在浏览器里访问/使用 OpenClaw(通过 Gateway 连接)

• 本地快速启动,便于二次开发与调试

本地安装(快速开始)

• 克隆项目并启动开发环境:

•

•

•

•

关键配置(连接 Gateway)

在

•

• 认证二选一(推荐 Token):

•

默认 Gateway 地址为:

相关文档:

链接:

• https://webclaw.dev/

• https://github.com/ibelick/webclaw

#OpenClaw #WebClaw #开源项目 #TypeScript #Web客户端

WebClaw 是一个面向 OpenClaw 的快速 Web 客户端,主打轻量、上手快,适合想用浏览器直接连接 OpenClaw Gateway 的用户与开发者。目前项目处于 Beta 阶段。

你可以用它做什么

• 在浏览器里访问/使用 OpenClaw(通过 Gateway 连接)

• 本地快速启动,便于二次开发与调试

本地安装(快速开始)

• 克隆项目并启动开发环境:

•

gh repo clone ibelick/webclaw•

cd webclaw•

pnpm install•

pnpm dev关键配置(连接 Gateway)

在

apps/webclaw/.env.local 中配置:•

CLAWDBOT_GATEWAY_URL• 认证二选一(推荐 Token):

•

CLAWDBOT_GATEWAY_TOKEN(推荐)或 CLAWDBOT_GATEWAY_PASSWORD默认 Gateway 地址为:

ws://127.0.0.1:18789相关文档:

https://docs.openclaw.ai/gateway链接:

• https://webclaw.dev/

• https://github.com/ibelick/webclaw

#OpenClaw #WebClaw #开源项目 #TypeScript #Web客户端

pure.md:把任意网页稳定转成适合 LLM 的 Markdown(还带“全球缓存”)

pure.md 提供一个简单的 REST API:只要在任意 URL 前加上

它能做什么:

• 更稳定地抓取网页:通过代理网络模拟真实用户行为,降低被识别为爬虫的概率;必要时还会尝试其他镜像来源。

• 渲染 JavaScript 重网页/SPA:自动完成 DOM hydration,避免只拿到“空壳 HTML”。

• 多格式转 Markdown:支持 HTML、PDF、图片(含识别与摘要)、以及表格文件(如 Excel/Numbers)等。

• 面向 LLM 的精简输出:减少页面冗余信息,附带元数据(frontmatter),降低 token 成本、提升推理效率。

• 实时搜索(SERP 抓取):把搜索结果聚合成可直接喂给提示词的 Markdown,让应用更“跟得上今天”。

• 按需数据抽取:把 GET 换成 POST,即可用内置生成式模型从页面中抽取结构化 JSON(可自定义 schema),或以流式文本返回。

定价概览:

• Starter:按量付费(60 req/min;fetch $0.003;search $0.005;不含 GenAI 抽取;含 $1 体验金)

• Growth:$19/月 + 计量(600 req/min;更低单价;含 GenAI 抽取;每月 $20 免费额度)

• Business:$99/月 + 计量(3000 req/min;更低单价;含 GenAI 抽取;每月 $100 免费额度)

原链接:https://pure.md/

#网页抓取 #Markdown #大模型工具 #内容提取 #数据抽取

pure.md 提供一个简单的 REST API:只要在任意 URL 前加上

pure.md/,就能更可靠地获取网页内容,并输出对大模型更友好的 Markdown。它能做什么:

• 更稳定地抓取网页:通过代理网络模拟真实用户行为,降低被识别为爬虫的概率;必要时还会尝试其他镜像来源。

• 渲染 JavaScript 重网页/SPA:自动完成 DOM hydration,避免只拿到“空壳 HTML”。

• 多格式转 Markdown:支持 HTML、PDF、图片(含识别与摘要)、以及表格文件(如 Excel/Numbers)等。

• 面向 LLM 的精简输出:减少页面冗余信息,附带元数据(frontmatter),降低 token 成本、提升推理效率。

• 实时搜索(SERP 抓取):把搜索结果聚合成可直接喂给提示词的 Markdown,让应用更“跟得上今天”。

• 按需数据抽取:把 GET 换成 POST,即可用内置生成式模型从页面中抽取结构化 JSON(可自定义 schema),或以流式文本返回。

定价概览:

• Starter:按量付费(60 req/min;fetch $0.003;search $0.005;不含 GenAI 抽取;含 $1 体验金)

• Growth:$19/月 + 计量(600 req/min;更低单价;含 GenAI 抽取;每月 $20 免费额度)

• Business:$99/月 + 计量(3000 req/min;更低单价;含 GenAI 抽取;每月 $100 免费额度)

原链接:https://pure.md/

#网页抓取 #Markdown #大模型工具 #内容提取 #数据抽取

Forma 工程系列导读:面向 AI 的“可变结构”数据存储怎么做?

AI 应用的数据结构变化速度,往往比传统数据库的建表/改表流程快得多:今天模型输出 12 个字段,明天变 30 个,下周又多出几个新字段——一旦数据库 schema 跟不上,轻则延迟飙升,重则直接线上事故。

这篇导读介绍了 Forma 的核心思路:只存“实际存在”的字段,让 schema 随 AI 输出演进。作者用“小票”做类比:

• 传统 SQL 表像一张列出所有可能商品的固定格式小票,没买的也要打印 0;新增商品就得重印格式(=改表)。

• EAV(Entity-Attribute-Value)更像只列出你真正买了什么:薯片、可乐;新增字段就直接加一行(=无需 DDL)。

当然,EAV 一直被认为是“反模式”,因为查询性能和可维护性都很差。Forma 的目标是:在保留灵活性的同时,把性能与一致性补回来。

Forma 是什么:三件事组合起来

Forma 面向 AI 时代的存储引擎,核心组合是:

• EAV 模式:新增字段不需要 ALTER TABLE,天然适配快速迭代

• JSON Schema:把“AI 输出”变成可验证的数据契约(写入时校验),提升类型安全与可控性

• PostgreSQL + DuckDB:OLTP/OLAP 分工 + 热冷分层,在成本与性能之间取得平衡

系列要解决的三个典型问题

1. AI 数据结构迭代太快

传统 DDL 流程(提工单→审批→维护窗口→改表)跟不上。系列第 1 篇会讲:JSON Schema + EAV + Hot Table 如何实现“零 DDL、写入即生效、仍然类型安全”。

2. EAV 的 N+1 查询噩梦

EAV 读数据常见的问题是:查 100 条记录可能触发 101 次往返,延迟轻松破 1s。系列第 2 篇会讲用 PostgreSQL 的 CTE + JSON_AGG 把 101 次查询压到 1 次,把延迟从 ~1000ms 降到 ~25ms。

3. 海量历史数据下的一致性与“脏读”担忧

数据到十亿级后,热冷分层几乎不可避免,但工程上最怕的是:联邦查询时读到未提交/不一致的数据。系列第 3 篇会讲通过 Anti-Join + Dirty Set 机制,做到联邦查询“零脏读”。

按你的场景选择阅读顺序

• 做 AI 应用,需要灵活存储:从 Post 1 开始

• 被 N+1 性能拖垮,想快速降延迟:直接看 Post 2

• 数据增长、准备上热冷分层 / Lakehouse:看 Post 3

• 想系统理解整体架构:按 1→2→3 顺序读

原文链接:https://blog.ltbase.dev/posts/forma/00-introduction-en

#EAV #JSONSchema #PostgreSQL #DuckDB #Lakehouse

AI 应用的数据结构变化速度,往往比传统数据库的建表/改表流程快得多:今天模型输出 12 个字段,明天变 30 个,下周又多出几个新字段——一旦数据库 schema 跟不上,轻则延迟飙升,重则直接线上事故。

这篇导读介绍了 Forma 的核心思路:只存“实际存在”的字段,让 schema 随 AI 输出演进。作者用“小票”做类比:

• 传统 SQL 表像一张列出所有可能商品的固定格式小票,没买的也要打印 0;新增商品就得重印格式(=改表)。

• EAV(Entity-Attribute-Value)更像只列出你真正买了什么:薯片、可乐;新增字段就直接加一行(=无需 DDL)。

当然,EAV 一直被认为是“反模式”,因为查询性能和可维护性都很差。Forma 的目标是:在保留灵活性的同时,把性能与一致性补回来。

Forma 是什么:三件事组合起来

Forma 面向 AI 时代的存储引擎,核心组合是:

• EAV 模式:新增字段不需要 ALTER TABLE,天然适配快速迭代

• JSON Schema:把“AI 输出”变成可验证的数据契约(写入时校验),提升类型安全与可控性

• PostgreSQL + DuckDB:OLTP/OLAP 分工 + 热冷分层,在成本与性能之间取得平衡

系列要解决的三个典型问题

1. AI 数据结构迭代太快

传统 DDL 流程(提工单→审批→维护窗口→改表)跟不上。系列第 1 篇会讲:JSON Schema + EAV + Hot Table 如何实现“零 DDL、写入即生效、仍然类型安全”。

2. EAV 的 N+1 查询噩梦

EAV 读数据常见的问题是:查 100 条记录可能触发 101 次往返,延迟轻松破 1s。系列第 2 篇会讲用 PostgreSQL 的 CTE + JSON_AGG 把 101 次查询压到 1 次,把延迟从 ~1000ms 降到 ~25ms。

3. 海量历史数据下的一致性与“脏读”担忧

数据到十亿级后,热冷分层几乎不可避免,但工程上最怕的是:联邦查询时读到未提交/不一致的数据。系列第 3 篇会讲通过 Anti-Join + Dirty Set 机制,做到联邦查询“零脏读”。

按你的场景选择阅读顺序

• 做 AI 应用,需要灵活存储:从 Post 1 开始

• 被 N+1 性能拖垮,想快速降延迟:直接看 Post 2

• 数据增长、准备上热冷分层 / Lakehouse:看 Post 3

• 想系统理解整体架构:按 1→2→3 顺序读

原文链接:https://blog.ltbase.dev/posts/forma/00-introduction-en

#EAV #JSONSchema #PostgreSQL #DuckDB #Lakehouse

VM0:用自然语言搭建 AI Agent,并在云端 24/7 运行

VM0 主打的是「面向 AI Agent 的基础设施」,让你用自然语言定义工作流、在云端沙盒环境里持续运行,并且能完整观测每次执行过程。

它能做什么

• 一键运行 Agent:支持按需执行或定时调度,适合做日报、监控、内容汇总等自动化任务。

• 自然语言构建工作流:在 Claude Code 里描述目标,协作编辑

• 云端隔离沙盒:本地开发、云端运行,环境隔离,适合让 Agent 长时间稳定跑任务。

• 全链路可观测:实时日志、产物输出、执行回放(checkpoint),便于排查与迭代。

示例场景(官网展示)

• HackerNews 摘要 Agent:自动读 Top 文章,筛选 AI 相关内容并生成可发布的总结。

• TikTok 达人筛选 Agent:搜索与筛选创作者,输出分析报告。

• 日报 Agent:聚合多源数据与 API,总结后写入 Notion。

• 博客生成 Agent:结合多个 API 自动产出内容。

快速开始(官网命令)

原链接:https://www.vm0.ai/

#AI代理 #自动化工作流 #云端沙盒 #可观测性 #开发者工具

VM0 主打的是「面向 AI Agent 的基础设施」,让你用自然语言定义工作流、在云端沙盒环境里持续运行,并且能完整观测每次执行过程。

它能做什么

• 一键运行 Agent:支持按需执行或定时调度,适合做日报、监控、内容汇总等自动化任务。

• 自然语言构建工作流:在 Claude Code 里描述目标,协作编辑

AGENTS.md,快速拼出可执行的 Agent 指令与流程。• 云端隔离沙盒:本地开发、云端运行,环境隔离,适合让 Agent 长时间稳定跑任务。

• 全链路可观测:实时日志、产物输出、执行回放(checkpoint),便于排查与迭代。

示例场景(官网展示)

• HackerNews 摘要 Agent:自动读 Top 文章,筛选 AI 相关内容并生成可发布的总结。

• TikTok 达人筛选 Agent:搜索与筛选创作者,输出分析报告。

• 日报 Agent:聚合多源数据与 API,总结后写入 Notion。

• 博客生成 Agent:结合多个 API 自动产出内容。

快速开始(官网命令)

npm install -g @vm0/cli && vm0 onboard原链接:https://www.vm0.ai/

#AI代理 #自动化工作流 #云端沙盒 #可观测性 #开发者工具

Agent Trace:为 AI 写的代码建立“可追溯”标准

Agent Trace 是一个开放规范,用来记录代码中哪些部分来自 AI、哪些来自人类,并把相关的模型信息、对话链接等“出处”一并纳入版本控制工作流中。它强调厂商中立,让不同工具都能读写同一套归因数据。

核心想解决什么

• 随着 Agent/代码助手产出越来越多代码,团队需要更清楚地知道:哪些改动是 AI 生成、用的是什么模型、对应哪次对话/会话。

• 这不是法律意义的“所有权”或“版权”判定,而是工程层面的来源记录与可审计性。

主要目标

• 互操作性:任何兼容工具都能写入/读取归因记录

• 细粒度:支持到**文件级、行号范围(line range)**的归因

• 可扩展:允许各家在不破坏兼容的情况下增加自定义元数据

• 人和 Agent 都能读懂:尽量不依赖特定 UI 才能理解

不做什么(边界很明确)

• 不处理代码法律归属、版权问题

• 不追踪训练数据来源

• 不做质量评估(不判断 AI 代码“好或坏”)

• 不绑定任何界面或产品形态

规范长什么样(概念速览)

Agent Trace 的基本单位是 Trace Record(JSON 记录),典型字段包括:

•

•

•

•

•

•

•

实现与落地

• 规范本身不规定 traces 存哪:可以是本地文件、git notes、数据库等。

• 提供了一个参考实现(含存储层、hook 集成),示范如何在文件变更时自动捕获归因信息。

链接:https://agent-trace.dev/

#AI编程 #代码归因 #工程规范 #可追溯性 #开发工具

Agent Trace 是一个开放规范,用来记录代码中哪些部分来自 AI、哪些来自人类,并把相关的模型信息、对话链接等“出处”一并纳入版本控制工作流中。它强调厂商中立,让不同工具都能读写同一套归因数据。

核心想解决什么

• 随着 Agent/代码助手产出越来越多代码,团队需要更清楚地知道:哪些改动是 AI 生成、用的是什么模型、对应哪次对话/会话。

• 这不是法律意义的“所有权”或“版权”判定,而是工程层面的来源记录与可审计性。

主要目标

• 互操作性:任何兼容工具都能写入/读取归因记录

• 细粒度:支持到**文件级、行号范围(line range)**的归因

• 可扩展:允许各家在不破坏兼容的情况下增加自定义元数据

• 人和 Agent 都能读懂:尽量不依赖特定 UI 才能理解

不做什么(边界很明确)

• 不处理代码法律归属、版权问题

• 不追踪训练数据来源

• 不做质量评估(不判断 AI 代码“好或坏”)

• 不绑定任何界面或产品形态

规范长什么样(概念速览)

Agent Trace 的基本单位是 Trace Record(JSON 记录),典型字段包括:

•

version / id / timestamp:规范版本、记录 ID、时间戳•

vcs:版本控制信息(如 git commit SHA;也支持 jj/hg/svn)•

tool:生成该记录的工具及版本•

files:文件列表;每个文件下按 conversation 分组•

conversations.url:指向产生这段代码的对话链接•

ranges:该对话贡献的行号范围(可选 content_hash 用于跨移动追踪)•

metadata:自定义扩展字段(建议用反向域名避免冲突,如 dev.cursor)实现与落地

• 规范本身不规定 traces 存哪:可以是本地文件、git notes、数据库等。

• 提供了一个参考实现(含存储层、hook 集成),示范如何在文件变更时自动捕获归因信息。

链接:https://agent-trace.dev/

#AI编程 #代码归因 #工程规范 #可追溯性 #开发工具

OpenClaw 正式亮相:把 AI 助手带到你常用的聊天软件里

OpenClaw 宣布品牌更名,并明确了项目定位:一个运行在你自己的机器上的开源 Agent 平台,可从你日常使用的聊天应用直接调用(WhatsApp、Telegram、Discord、Slack、Teams 等),让 AI 助手“跟着你走”。

为什么改名:从 Clawd / Moltbot 到 OpenClaw

团队经历了多次命名迭代:

• Clawd:好记但涉及商标/法务问题,被建议更换

• Moltbot:寓意“蜕壳成长”,但不够顺口

• OpenClaw:已完成商标检索、域名与迁移准备,强调两点:

• Open:开源、开放、社区驱动

• Claw:延续“龙虾”项目起源与文化

OpenClaw 是什么:你的助手,你的规则

核心主张很直接:Your assistant. Your machine. Your rules.

不同于把数据放在第三方服务器上的 SaaS 助手,OpenClaw 允许你把系统跑在本地电脑、家用服务器或 VPS 上:基础设施你掌控、密钥你掌控、数据也由你掌控。

本次发布更新亮点

随更名一起上线的更新包括:

• 新渠道:新增 Twitch、Google Chat 插件

• 模型支持:新增 KIMI K2.5、Xiaomi MiMo-V2-Flash

• Web Chat:支持像聊天软件一样发送图片

• 安全加固:累计 34 个与安全相关的提交,并发布可机器验证的安全模型;同时提醒 prompt injection 仍是行业难题,建议参考安全最佳实践

接下来:安全优先 + 维护体系建设

团队表示下一阶段会继续把安全作为最高优先级,同时提升网关稳定性、体验打磨,并扩展更多模型与提供商支持。由于项目增长迅猛,也在引入更多维护者并建立流程,鼓励社区参与贡献或赞助维护工作。

原链接:https://openclaw.ai/blog/introducing-openclaw

#开源 #AI代理 #隐私安全 #自托管 #聊天机器人

OpenClaw 宣布品牌更名,并明确了项目定位:一个运行在你自己的机器上的开源 Agent 平台,可从你日常使用的聊天应用直接调用(WhatsApp、Telegram、Discord、Slack、Teams 等),让 AI 助手“跟着你走”。

为什么改名:从 Clawd / Moltbot 到 OpenClaw

团队经历了多次命名迭代:

• Clawd:好记但涉及商标/法务问题,被建议更换

• Moltbot:寓意“蜕壳成长”,但不够顺口

• OpenClaw:已完成商标检索、域名与迁移准备,强调两点:

• Open:开源、开放、社区驱动

• Claw:延续“龙虾”项目起源与文化

OpenClaw 是什么:你的助手,你的规则

核心主张很直接:Your assistant. Your machine. Your rules.

不同于把数据放在第三方服务器上的 SaaS 助手,OpenClaw 允许你把系统跑在本地电脑、家用服务器或 VPS 上:基础设施你掌控、密钥你掌控、数据也由你掌控。

本次发布更新亮点

随更名一起上线的更新包括:

• 新渠道:新增 Twitch、Google Chat 插件

• 模型支持:新增 KIMI K2.5、Xiaomi MiMo-V2-Flash

• Web Chat:支持像聊天软件一样发送图片

• 安全加固:累计 34 个与安全相关的提交,并发布可机器验证的安全模型;同时提醒 prompt injection 仍是行业难题,建议参考安全最佳实践

接下来:安全优先 + 维护体系建设

团队表示下一阶段会继续把安全作为最高优先级,同时提升网关稳定性、体验打磨,并扩展更多模型与提供商支持。由于项目增长迅猛,也在引入更多维护者并建立流程,鼓励社区参与贡献或赞助维护工作。

原链接:https://openclaw.ai/blog/introducing-openclaw

#开源 #AI代理 #隐私安全 #自托管 #聊天机器人

Moltbook:面向 AI Agent 的“社交广场”

Moltbook 把“社交网络”做成了 AI Agent 的主场:Agent 在这里发布内容、讨论、点赞投票;人类也可以围观、了解它们都在做什么。

你能在 Moltbook 看到什么?

• 海量 Agent 与社区分区(Submolts):按主题聚合讨论与内容流

• 动态广场(Posts):从自动化工作流、工具技巧,到各类实验与想法分享

• 人机配对(Top Pairings):展示 Agent 与其绑定的人类账号/身份影响力(平台内视角)

如果你想“把 Agent 送进去”

• 官方给了一个简单的上手方式:把指令发给你的 Agent,让它按说明注册并生成认领链接,再通过社交平台验证归属。

面向开发者

• Moltbook 也在推进开发者平台:允许应用通过 Moltbook 身份与 Agent 做认证与集成(当前以申请早期访问为主)。

链接:https://www.moltbook.com/

#AI智能体 #社交网络 #开发者平台 #AI应用 #社区观察

Moltbook 把“社交网络”做成了 AI Agent 的主场:Agent 在这里发布内容、讨论、点赞投票;人类也可以围观、了解它们都在做什么。

你能在 Moltbook 看到什么?

• 海量 Agent 与社区分区(Submolts):按主题聚合讨论与内容流

• 动态广场(Posts):从自动化工作流、工具技巧,到各类实验与想法分享

• 人机配对(Top Pairings):展示 Agent 与其绑定的人类账号/身份影响力(平台内视角)

如果你想“把 Agent 送进去”

• 官方给了一个简单的上手方式:把指令发给你的 Agent,让它按说明注册并生成认领链接,再通过社交平台验证归属。

面向开发者

• Moltbook 也在推进开发者平台:允许应用通过 Moltbook 身份与 Agent 做认证与集成(当前以申请早期访问为主)。

链接:https://www.moltbook.com/

#AI智能体 #社交网络 #开发者平台 #AI应用 #社区观察

Vercel AI Gateway 现已支持 Claude Code Max:订阅直连、统一观测

Vercel 宣布其 AI Gateway 现已支持在 Claude Code CLI 中使用 Claude Code Max 订阅。对开发者来说,这意味着:你可以继续用自己已有的 Anthropic 订阅,不增加额外费用,同时把 Claude Code 的调用统一接入 Vercel 平台,获得更完整的可观测性、用量追踪与监控能力。

你能获得什么

• 沿用现有 Claude Code Max 订阅:照常用 Anthropic 模型,无需额外开销

• 统一观测与用量管理:通过 Vercel 平台查看请求、监控使用模式与成本趋势

• 更灵活的路由能力:AI Gateway 可作为直通 Anthropic 的代理;必要时也可作为路由器切换到其他提供方(fallback)

快速配置(核心步骤)

在你的 shell 配置文件(如

• 将 Anthropic 入口指向 AI Gateway

• 用独立的

启动 Claude Code:

• 运行

• 登录时选择 Option 1 - Claude account with subscription(使用带订阅的 Claude 账号)

• 若遇到问题,可先

工作原理(简述)

Claude Code 仍然使用 Anthropic 的订阅凭证进行认证,并携带

原文链接:https://vercel.com/changelog/claude-code-max-via-ai-gateway-available-now-for-claude-code

#Vercel #AIGateway #ClaudeCode #可观测性 #开发者工具

Vercel 宣布其 AI Gateway 现已支持在 Claude Code CLI 中使用 Claude Code Max 订阅。对开发者来说,这意味着:你可以继续用自己已有的 Anthropic 订阅,不增加额外费用,同时把 Claude Code 的调用统一接入 Vercel 平台,获得更完整的可观测性、用量追踪与监控能力。

你能获得什么

• 沿用现有 Claude Code Max 订阅:照常用 Anthropic 模型,无需额外开销

• 统一观测与用量管理:通过 Vercel 平台查看请求、监控使用模式与成本趋势

• 更灵活的路由能力:AI Gateway 可作为直通 Anthropic 的代理;必要时也可作为路由器切换到其他提供方(fallback)

快速配置(核心步骤)

在你的 shell 配置文件(如

~/.zshrc 或 ~/.bashrc)加入环境变量:• 将 Anthropic 入口指向 AI Gateway

• 用独立的

x-ai-gateway-api-key 做网关鉴权(与 Claude 订阅鉴权并存)启动 Claude Code:

• 运行

claude• 登录时选择 Option 1 - Claude account with subscription(使用带订阅的 Claude 账号)

• 若遇到问题,可先

claude /logout 再重新登录工作原理(简述)

Claude Code 仍然使用 Anthropic 的订阅凭证进行认证,并携带

Authorization 头。由于该头用于 Claude 订阅身份,AI Gateway 采用单独的 x-ai-gateway-api-key 进行自身认证,从而实现两套鉴权机制同时生效。原文链接:https://vercel.com/changelog/claude-code-max-via-ai-gateway-available-now-for-claude-code

#Vercel #AIGateway #ClaudeCode #可观测性 #开发者工具

Cloud Code:把 OpenCode 变成跑在 Cloudflare 上的专属云端 Agent

Cloud Code 是一个基于 Cloudflare Workers + Cloudflare Containers 的 TypeScript 项目,把 OpenCode 以容器化方式运行在 Cloudflare 基础设施上,帮助你快速搭建“云端开发/编码 Agent”。

它能做什么

• 一键部署到 Cloudflare(项目提供 Deploy to Cloudflare 入口)

• 本地开发友好:用 Wrangler 模拟 Workers 环境,支持

• 可选 Basic Auth 保护:配置

• 数据持久化(S3/R2):通过 TigrisFS 将对象存储挂载为本地目录

• 默认挂载到

• OpenCode 配置也会落到

• 内置 Cloudflared:可把容器内服务通过 Cloudflare Tunnel 暴露到公网,方便调试/临时分享

运行与部署要点(简版)

• 依赖:Node.js(推荐 v20+)、pnpm、Wrangler

• 常用命令:

• 若改了

原链接:https://github.com/miantiao-me/cloud-code

#Cloudflare #OpenCode #Workers #容器化 #S3R2

Cloud Code 是一个基于 Cloudflare Workers + Cloudflare Containers 的 TypeScript 项目,把 OpenCode 以容器化方式运行在 Cloudflare 基础设施上,帮助你快速搭建“云端开发/编码 Agent”。

它能做什么

• 一键部署到 Cloudflare(项目提供 Deploy to Cloudflare 入口)

• 本地开发友好:用 Wrangler 模拟 Workers 环境,支持

pnpm dev / pnpm start• 可选 Basic Auth 保护:配置

SERVER_USERNAME / SERVER_PASSWORD 后启用,避免未授权访问• 数据持久化(S3/R2):通过 TigrisFS 将对象存储挂载为本地目录

• 默认挂载到

/root/s3,工作区在 /root/s3/workspace• OpenCode 配置也会落到

/root/s3/.opencode,便于状态持久化• 内置 Cloudflared:可把容器内服务通过 Cloudflare Tunnel 暴露到公网,方便调试/临时分享

运行与部署要点(简版)

• 依赖:Node.js(推荐 v20+)、pnpm、Wrangler

• 常用命令:

pnpm install → pnpm dev(本地)→ pnpm deploy(部署)• 若改了

wrangler.jsonc 绑定:记得执行 pnpm cf-typegen 重新生成类型原链接:https://github.com/miantiao-me/cloud-code

#Cloudflare #OpenCode #Workers #容器化 #S3R2

Clawdbot:运行在你自己电脑上的个人 AI 助手

Clawdbot 主打“AI 真的能做事”:它不是一个被托管在平台里的聊天机器人,而是运行在你的 Mac/Windows/Linux 上,能连接常用通讯工具与各类服务,把对话变成可执行的任务流。

它能做什么

• 本地运行、隐私优先:在你的设备上工作,数据默认留在你手里;可接入 Anthropic / OpenAI,也支持本地模型。

• 任意聊天软件对话:WhatsApp、Telegram、Discord、Slack、Signal、iMessage 等都能用(支持私聊和群聊)。

• 持久记忆:能记住你的偏好与上下文,越用越“懂你”。

• 浏览器自动化:可浏览网页、填表、抓取信息。

• 系统级能力:读写文件、运行命令、执行脚本(可全权限或沙箱化)。

• 技能/插件机制:用社区技能扩展,也可以让它帮你写自己的技能。

• 集成丰富:官方列出 50+ 集成(如 Gmail、GitHub、Obsidian、Spotify、Hue 等)。

快速上手(官方提供的一键方式)

• 一键安装:

• 安装 CLI:

• 开始引导:

• 另有 macOS 菜单栏 Companion App(Beta),适合和 CLI 搭配使用。

https://clawd.bot/

#AI助手 #开源工具 #自动化 #个人效率 #智能体

Clawdbot 主打“AI 真的能做事”:它不是一个被托管在平台里的聊天机器人,而是运行在你的 Mac/Windows/Linux 上,能连接常用通讯工具与各类服务,把对话变成可执行的任务流。

它能做什么

• 本地运行、隐私优先:在你的设备上工作,数据默认留在你手里;可接入 Anthropic / OpenAI,也支持本地模型。

• 任意聊天软件对话:WhatsApp、Telegram、Discord、Slack、Signal、iMessage 等都能用(支持私聊和群聊)。

• 持久记忆:能记住你的偏好与上下文,越用越“懂你”。

• 浏览器自动化:可浏览网页、填表、抓取信息。

• 系统级能力:读写文件、运行命令、执行脚本(可全权限或沙箱化)。

• 技能/插件机制:用社区技能扩展,也可以让它帮你写自己的技能。

• 集成丰富:官方列出 50+ 集成(如 Gmail、GitHub、Obsidian、Spotify、Hue 等)。

快速上手(官方提供的一键方式)

• 一键安装:

curl -fsSL https://clawd.bot/install.sh | bash• 安装 CLI:

npm i -g clawdbot• 开始引导:

clawdbot onboard• 另有 macOS 菜单栏 Companion App(Beta),适合和 CLI 搭配使用。

https://clawd.bot/

#AI助手 #开源工具 #自动化 #个人效率 #智能体

AgentFS:为 AI Agent 设计的“可审计”文件系统

AgentFS 是 Turso 团队开源的 面向 AI Agent 的文件系统:不仅能像传统文件系统一样读写文件/目录,还把 Agent 的状态与行为记录成可查询、可快照的结构化数据,便于调试与复盘。

它解决什么问题?

• 可审计:每一次文件操作、工具调用、状态变更都会写入同一个 SQLite 数据库,可直接用 SQL 追踪“发生了什么”。

• 可复现:一个

• 可迁移:所有内容都封装在单个 SQLite 文件里,易于移动、备份,甚至纳入版本管理。

包含哪些组件?

• SDK:TypeScript / Python / Rust(程序化访问文件系统、KV、工具调用记录)。

• CLI:初始化与管理 AgentFS;在 Linux 用 FUSE、macOS 用 NFS 挂载到本机目录;也可在沙箱里把它挂载到

• 规范:提供基于 SQLite 的 Agent 文件系统规格(SPEC)。

使用提醒

• 官方标注为 ALPHA 阶段:更适合开发、测试与实验环境,关键数据请谨慎上生产。

原链接:https://github.com/tursodatabase/agentfs

#AI代理 #文件系统 #SQLite #可审计 #开发工具

AgentFS 是 Turso 团队开源的 面向 AI Agent 的文件系统:不仅能像传统文件系统一样读写文件/目录,还把 Agent 的状态与行为记录成可查询、可快照的结构化数据,便于调试与复盘。

它解决什么问题?

• 可审计:每一次文件操作、工具调用、状态变更都会写入同一个 SQLite 数据库,可直接用 SQL 追踪“发生了什么”。

• 可复现:一个

.db 文件就是完整运行态,支持复制/快照/回滚,用来复现某次执行或做 what-if 实验。• 可迁移:所有内容都封装在单个 SQLite 文件里,易于移动、备份,甚至纳入版本管理。

包含哪些组件?

• SDK:TypeScript / Python / Rust(程序化访问文件系统、KV、工具调用记录)。

• CLI:初始化与管理 AgentFS;在 Linux 用 FUSE、macOS 用 NFS 挂载到本机目录;也可在沙箱里把它挂载到

/agent。• 规范:提供基于 SQLite 的 Agent 文件系统规格(SPEC)。

使用提醒

• 官方标注为 ALPHA 阶段:更适合开发、测试与实验环境,关键数据请谨慎上生产。

原链接:https://github.com/tursodatabase/agentfs

#AI代理 #文件系统 #SQLite #可审计 #开发工具

CoreSpeed:为 AI Agent 打造的容器运行时基础设施

CoreSpeed 主打把「Agent 运行」这件事做成开箱即用的基础设施:你可以像部署普通容器一样部署 AI Agent,并获得更快启动、更强隔离和更易扩展的体验。

它解决的核心问题:把 Agent 从 Demo 变成可上线的系统。

关键能力一览

• 127ms 级别快速启动:通过内置 Warm Pool,让容器接近“秒开/毫秒开”,减少冷启动等待。

• 按用户隔离的安全沙箱:一人一容器,降低数据串扰与安全风险。

• 无限水平扩展 + 可缩到 0:按需分配资源,空闲可降到零成本运行。

• AI & MCP Gateway:统一接入 AI 模型与 MCP Server,提供可观测性与安全防护(例如减少 API Key 泄露风险),并支持按调用计费。

配套:Zypher(TypeScript Agent Runtime)

同时他们提供 Zypher SDK,强调:

• 不是固定工作流,而是「真 Agent」的反应式循环

• 模型/供应商无关(Claude、GPT 等)

• 多 Agent 协作架构

• 丰富工具与 MCP 协议支持

• 更节省 Token 的上下文加载与执行策略

原文链接:https://www.corespeed.io/

#AI代理 #容器基础设施 #MCP #AgentRuntime #开发者工具

CoreSpeed 主打把「Agent 运行」这件事做成开箱即用的基础设施:你可以像部署普通容器一样部署 AI Agent,并获得更快启动、更强隔离和更易扩展的体验。

它解决的核心问题:把 Agent 从 Demo 变成可上线的系统。

关键能力一览

• 127ms 级别快速启动:通过内置 Warm Pool,让容器接近“秒开/毫秒开”,减少冷启动等待。

• 按用户隔离的安全沙箱:一人一容器,降低数据串扰与安全风险。

• 无限水平扩展 + 可缩到 0:按需分配资源,空闲可降到零成本运行。

• AI & MCP Gateway:统一接入 AI 模型与 MCP Server,提供可观测性与安全防护(例如减少 API Key 泄露风险),并支持按调用计费。

配套:Zypher(TypeScript Agent Runtime)

同时他们提供 Zypher SDK,强调:

• 不是固定工作流,而是「真 Agent」的反应式循环

• 模型/供应商无关(Claude、GPT 等)

• 多 Agent 协作架构

• 丰富工具与 MCP 协议支持

• 更节省 Token 的上下文加载与执行策略

原文链接:https://www.corespeed.io/

#AI代理 #容器基础设施 #MCP #AgentRuntime #开发者工具

Amp 宣布下线 Amp Tab:Tab 补全时代正在退场

Amp 团队宣布将移除 Amp Tab(内联 Tab 补全功能),理由很直接:这不再符合他们看到的未来。

他们的判断基于一个变化——AI 写代码的占比正在迅速上升:

• 一年前,代码大多还是人手写

• 2025 年 6 月发布 Amp Tab 时,Amp 已经在写大部分代码

• 现在,Amp 负责了他们 90% 的交付代码

Amp 认为,Tab 补全与传统补全引擎来自“人写为主、AI 辅助”的时代;但这个时代正在结束。越来越多用户的工作方式变成:几天不打开编辑器,也能持续交付代码。瓶颈不再是“写得快不快”,而是“把代码产出、落地得快不快”。

因此,Amp 将把资源投入到“后补全时代”的方向:默认由智能体(agents)完成大部分编码工作,而不是在输入时做局部补全。

时间安排:

• Amp Tab 将继续可用至 2026 年 1 月底

• 之后如果仍需要内联补全,可考虑:Cursor / GitHub Copilot / Zed

原文链接:https://ampcode.com/news/tab-tab-dead

#AI编程 #代码补全 #开发者工具 #智能体 #Amp

Amp 团队宣布将移除 Amp Tab(内联 Tab 补全功能),理由很直接:这不再符合他们看到的未来。

他们的判断基于一个变化——AI 写代码的占比正在迅速上升:

• 一年前,代码大多还是人手写

• 2025 年 6 月发布 Amp Tab 时,Amp 已经在写大部分代码

• 现在,Amp 负责了他们 90% 的交付代码

Amp 认为,Tab 补全与传统补全引擎来自“人写为主、AI 辅助”的时代;但这个时代正在结束。越来越多用户的工作方式变成:几天不打开编辑器,也能持续交付代码。瓶颈不再是“写得快不快”,而是“把代码产出、落地得快不快”。

因此,Amp 将把资源投入到“后补全时代”的方向:默认由智能体(agents)完成大部分编码工作,而不是在输入时做局部补全。

时间安排:

• Amp Tab 将继续可用至 2026 年 1 月底

• 之后如果仍需要内联补全,可考虑:Cursor / GitHub Copilot / Zed

原文链接:https://ampcode.com/news/tab-tab-dead

#AI编程 #代码补全 #开发者工具 #智能体 #Amp

以“推理速度”交付:AI 编程把瓶颈从写代码变成了等模型

这篇文章的核心观点很直接:AI 编程代理的能力跃迁后,作者交付软件的速度越来越不取决于“敲代码”,而更受限于两件事——模型推理时间(inference time)和少数真正需要深度思考的设计决策。

作者回顾了今年的变化:从最初“有些提示能一次跑通就很惊喜”,到现在“默认就该一次跑通”。在这种前提下,他甚至不再逐行读代码,而是看执行/修改流,关注系统结构是否合理、关键组件在哪里、整体是否按预期运转。

文章也给了不少可复用的工作方法:

• 先从 CLI 做起:任何产品先做命令行版本,方便代理直接运行验证,形成闭环;核心逻辑稳了再上 UI(比如扩展、App)。

• 关键决策是生态与依赖:语言/框架/依赖选对了,代理更容易一次完成;作者常用 TypeScript(Web)、Go(CLI)、Swift(macOS/iOS)。

• 更偏向“对话式协作”,而不是复杂流程:先和模型聊清楚、让它探索代码、共创方案,满意后再让它开干;他认为“Plan mode”更像旧时代不得已的手段。

• 对比 codex 与 Opus:codex 常会先长时间读代码再动手,虽然更慢但更稳,尤其适合大型功能和重构;Opus 更“急”,适合小改动但更容易漏上下文。

• 迭代式构建,不依赖回滚:不喜欢 checkpoint/频繁 revert,更多是让模型继续改、继续朝更好的方向“绕山而上”。

• 自动化与多项目并行:同时推进多个项目,用队列把想法排进去;瓶颈往往是人而不是编排系统。

• 配置思路:提高工具输出 token 上限、合理设置自动压缩阈值,让模型能一次读更多文件;作者强调新压缩机制更可靠,甚至像一次“复查”。

如果用一句话总结:当“写代码”越来越像可并行外包给代理的体力活,工程师的价值更集中在选型、架构、数据流、约束定义与验收标准上;而真正影响交付速度的,往往是推理等待时间和你是否想清楚要做什么。

原链接:https://steipete.me/posts/2025/shipping-at-inference-speed

#AI编程 #Codex #开发工作流 #效率工具 #软件工程

这篇文章的核心观点很直接:AI 编程代理的能力跃迁后,作者交付软件的速度越来越不取决于“敲代码”,而更受限于两件事——模型推理时间(inference time)和少数真正需要深度思考的设计决策。

作者回顾了今年的变化:从最初“有些提示能一次跑通就很惊喜”,到现在“默认就该一次跑通”。在这种前提下,他甚至不再逐行读代码,而是看执行/修改流,关注系统结构是否合理、关键组件在哪里、整体是否按预期运转。

文章也给了不少可复用的工作方法:

• 先从 CLI 做起:任何产品先做命令行版本,方便代理直接运行验证,形成闭环;核心逻辑稳了再上 UI(比如扩展、App)。

• 关键决策是生态与依赖:语言/框架/依赖选对了,代理更容易一次完成;作者常用 TypeScript(Web)、Go(CLI)、Swift(macOS/iOS)。

• 更偏向“对话式协作”,而不是复杂流程:先和模型聊清楚、让它探索代码、共创方案,满意后再让它开干;他认为“Plan mode”更像旧时代不得已的手段。

• 对比 codex 与 Opus:codex 常会先长时间读代码再动手,虽然更慢但更稳,尤其适合大型功能和重构;Opus 更“急”,适合小改动但更容易漏上下文。

• 迭代式构建,不依赖回滚:不喜欢 checkpoint/频繁 revert,更多是让模型继续改、继续朝更好的方向“绕山而上”。

• 自动化与多项目并行:同时推进多个项目,用队列把想法排进去;瓶颈往往是人而不是编排系统。

• 配置思路:提高工具输出 token 上限、合理设置自动压缩阈值,让模型能一次读更多文件;作者强调新压缩机制更可靠,甚至像一次“复查”。

如果用一句话总结:当“写代码”越来越像可并行外包给代理的体力活,工程师的价值更集中在选型、架构、数据流、约束定义与验收标准上;而真正影响交付速度的,往往是推理等待时间和你是否想清楚要做什么。

原链接:https://steipete.me/posts/2025/shipping-at-inference-speed

#AI编程 #Codex #开发工作流 #效率工具 #软件工程