大语言模型(LLM)是如何运作的?一文拆解它的底层逻辑

从 GPT、Claude 到 LLaMA,大语言模型看似无所不知,但其背后的技术大多高度收敛于 Transformer 架构。本文为你快速拆解 LLM 运行的 6 个核心步骤:

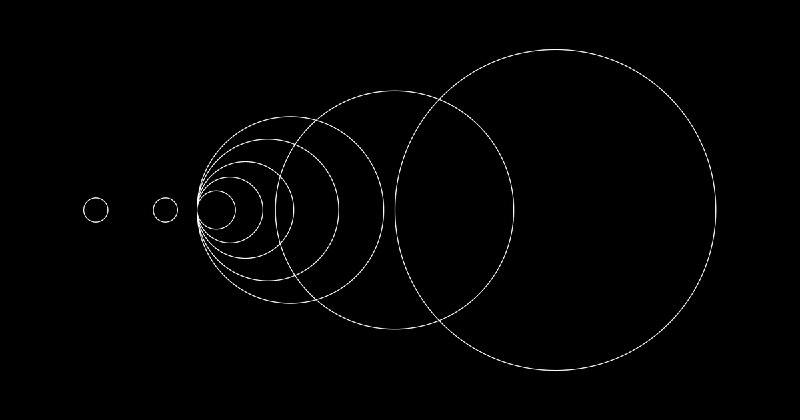

1. 分词与嵌入(Tokenization & Embeddings)

模型不直接阅读文本。你的输入首先会被拆解为子词 Token,并转化为数字 ID。随后,这些 ID 通过“嵌入矩阵”变成高维向量。在向量空间中,语义相近的词(如“猫”和“狗”)会被分配到相邻的位置,从而获得“语义”。

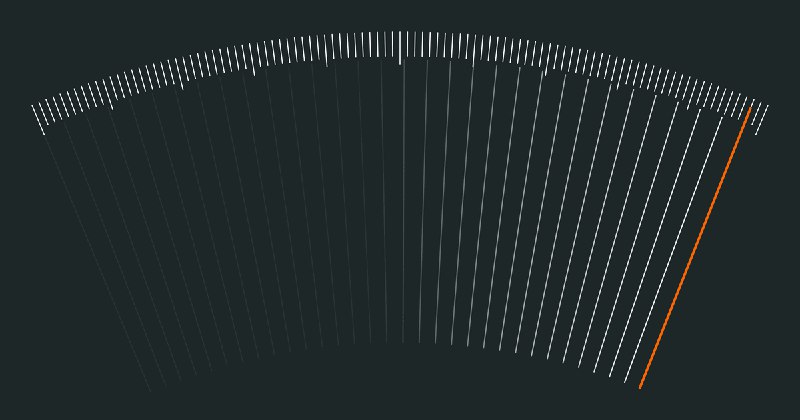

2. 位置编码(Positional Encoding)

普通的注意力机制无法分辨词序。现代模型主要使用 RoPE(旋转位置编码),通过旋转向量来标记 Token 之间的相对距离,让模型知道哪个词在前,哪个词在后。

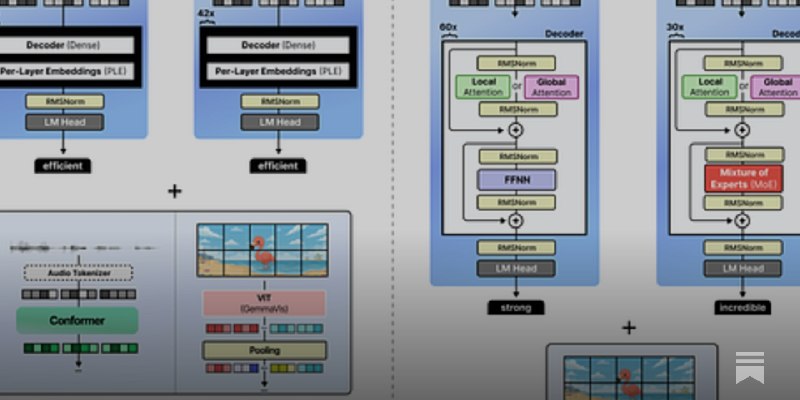

3. 注意力机制(Attention & Multi-Head)

这是 Transformer 的灵魂。每个 Token 会通过 Query(寻找什么)、Key(匹配什么)和 Value(传递什么)三种角色与其他 Token 进行信息交互。为了同时捕捉语法、代词指代等多种关系,模型会并行运行多个注意力“头”。现代模型多采用 GQA(分组查询注意力) 来大幅降低显存占用。

4. 前馈网络(FFN & MoE)

如果说注意力机制是 Token 之间的“对话”,前馈网络就是 Token 的“自我思考”。模型的大部分 factual 记忆都存储在这里。为了在不增加计算成本的前提下扩大参数量,现代大模型(如 Mixtral)常使用 MoE(混合专家模型),每次只激活部分网络来处理 Token。

5. 残差流与归一化(Residual Stream & RMSNorm)

随着网络层数变深,信号容易衰减或爆炸。残差连接允许原始信息绕过部分计算直接向后传递,而 RMSNorm 则在每层计算前对数据进行重缩放,确保数百层的网络能够稳定训练。

6. 预测下一个 Token(Next-Token Prediction)

LLM 的本质是一个“词语接龙”游戏。模型在最后一层输出所有候选词的概率分布,根据设定的“温度(Temperature)”等参数抽取下一个 Token,并将其拼回输入,循环往复,直到生成完整文本。

总结来说,如今的 LLM 架构在工程上已经高度趋同(RoPE、GQA、SwiGLU、RMSNorm 的组合)。不同模型之间的差异,主要源于训练数据集、参数规模以及后期的对齐微调(RLHF)。

阅读完整英文博文:https://www.0xkato.xyz/how-llms-actually-work/

#大语言模型 #Transformer #人工智能 #深度学习 #技术科普

从 GPT、Claude 到 LLaMA,大语言模型看似无所不知,但其背后的技术大多高度收敛于 Transformer 架构。本文为你快速拆解 LLM 运行的 6 个核心步骤:

1. 分词与嵌入(Tokenization & Embeddings)

模型不直接阅读文本。你的输入首先会被拆解为子词 Token,并转化为数字 ID。随后,这些 ID 通过“嵌入矩阵”变成高维向量。在向量空间中,语义相近的词(如“猫”和“狗”)会被分配到相邻的位置,从而获得“语义”。

2. 位置编码(Positional Encoding)

普通的注意力机制无法分辨词序。现代模型主要使用 RoPE(旋转位置编码),通过旋转向量来标记 Token 之间的相对距离,让模型知道哪个词在前,哪个词在后。

3. 注意力机制(Attention & Multi-Head)

这是 Transformer 的灵魂。每个 Token 会通过 Query(寻找什么)、Key(匹配什么)和 Value(传递什么)三种角色与其他 Token 进行信息交互。为了同时捕捉语法、代词指代等多种关系,模型会并行运行多个注意力“头”。现代模型多采用 GQA(分组查询注意力) 来大幅降低显存占用。

4. 前馈网络(FFN & MoE)

如果说注意力机制是 Token 之间的“对话”,前馈网络就是 Token 的“自我思考”。模型的大部分 factual 记忆都存储在这里。为了在不增加计算成本的前提下扩大参数量,现代大模型(如 Mixtral)常使用 MoE(混合专家模型),每次只激活部分网络来处理 Token。

5. 残差流与归一化(Residual Stream & RMSNorm)

随着网络层数变深,信号容易衰减或爆炸。残差连接允许原始信息绕过部分计算直接向后传递,而 RMSNorm 则在每层计算前对数据进行重缩放,确保数百层的网络能够稳定训练。

6. 预测下一个 Token(Next-Token Prediction)

LLM 的本质是一个“词语接龙”游戏。模型在最后一层输出所有候选词的概率分布,根据设定的“温度(Temperature)”等参数抽取下一个 Token,并将其拼回输入,循环往复,直到生成完整文本。

总结来说,如今的 LLM 架构在工程上已经高度趋同(RoPE、GQA、SwiGLU、RMSNorm 的组合)。不同模型之间的差异,主要源于训练数据集、参数规模以及后期的对齐微调(RLHF)。

阅读完整英文博文:https://www.0xkato.xyz/how-llms-actually-work/

#大语言模型 #Transformer #人工智能 #深度学习 #技术科普