无原创,纯转发

Kata Containers:兼具容器的速度与虚拟机的安全

这是一个开源容器运行时,它利用轻量级虚拟机,在提供硬件级强隔离的同时,保持了容器般的速度和体验,有效解决了传统容器共享内核带来的安全风险。

主要特性:

🚀 性能:性能媲美标准 Linux 容器,没有传统虚拟机的性能损耗。

🛡️ 安全:通过硬件虚拟化技术 (VT 扩展) 实现内核、网络、I/O 和内存的全面隔离。

🧩 兼容性:支持 OCI 容器格式、Kubernetes CRI 接口等行业标准。

💡 简洁性:无需在完整虚拟机中嵌套容器,易于集成和使用。

该项目由 Open Infrastructure Foundation 管理,整合了 Intel Clear Containers 和 Hyper.sh RunV 的优点,并支持 QEMU、Cloud-Hypervisor 和 Firecracker 等多种管理程序。

原文链接:https://katacontainers.io/

这是一个开源容器运行时,它利用轻量级虚拟机,在提供硬件级强隔离的同时,保持了容器般的速度和体验,有效解决了传统容器共享内核带来的安全风险。

主要特性:

🚀 性能:性能媲美标准 Linux 容器,没有传统虚拟机的性能损耗。

🛡️ 安全:通过硬件虚拟化技术 (VT 扩展) 实现内核、网络、I/O 和内存的全面隔离。

🧩 兼容性:支持 OCI 容器格式、Kubernetes CRI 接口等行业标准。

💡 简洁性:无需在完整虚拟机中嵌套容器,易于集成和使用。

该项目由 Open Infrastructure Foundation 管理,整合了 Intel Clear Containers 和 Hyper.sh RunV 的优点,并支持 QEMU、Cloud-Hypervisor 和 Firecracker 等多种管理程序。

原文链接:https://katacontainers.io/

GitHub Copilot 编辑建议功能的进化之路

GitHub Copilot 的“下一处编辑建议” (NES) 功能旨在预测并推荐开发者下一步的代码修改,这项任务比简单的代码补全更具挑战性,因为它需要深入理解开发者的意图,并做到快速响应且不过度干扰.

关键突破:高质量的训练数据

团队发现,使用最终的 Pull Request 数据训练模型效果不佳,因为它无法反映开发者在编码过程中的真实、动态的编辑行为. 于是,他们转而收集内部志愿者的实时编码会话,构建了一个高质量的数据集. 事实证明,这比海量但不够精确的数据更有效.

从监督微调到强化学习

1. 监督微调 (SFT):利用上述高质量数据集,团队成功训练出第一个表现优异的 NES 模型.

2. 强化学习 (RL):为解决 SFT 无法教会模型“什么是不好的建议”这一问题,团队引入了强化学习. 通过设计一个“评分器”来判断建议质量,模型得以在更广泛的数据上进行训练,学会避免生成干扰性的建议.

最新模型的改进

最新版本的 NES 模型在多个方面进行了优化:

- 提示词优化:减少了上下文长度,提升响应速度.

- 数据质量过滤:使用大模型筛选训练数据,减少无用建议.

- 合成数据:从大模型蒸馏知识,训练出更高效的小模型.

- 超参数调整:为新架构优化参数,提升建议质量.

成果与未来

通过持续迭代,NES 模型的建议接受率提升了 26.5%,而隐藏率则降低了 25.6%. 未来,GitHub 计划让 NES 支持跨文件建议、提供更快的响应并更智能地理解上下文.

原文链接

GitHub Copilot 的“下一处编辑建议” (NES) 功能旨在预测并推荐开发者下一步的代码修改,这项任务比简单的代码补全更具挑战性,因为它需要深入理解开发者的意图,并做到快速响应且不过度干扰.

关键突破:高质量的训练数据

团队发现,使用最终的 Pull Request 数据训练模型效果不佳,因为它无法反映开发者在编码过程中的真实、动态的编辑行为. 于是,他们转而收集内部志愿者的实时编码会话,构建了一个高质量的数据集. 事实证明,这比海量但不够精确的数据更有效.

从监督微调到强化学习

1. 监督微调 (SFT):利用上述高质量数据集,团队成功训练出第一个表现优异的 NES 模型.

2. 强化学习 (RL):为解决 SFT 无法教会模型“什么是不好的建议”这一问题,团队引入了强化学习. 通过设计一个“评分器”来判断建议质量,模型得以在更广泛的数据上进行训练,学会避免生成干扰性的建议.

最新模型的改进

最新版本的 NES 模型在多个方面进行了优化:

- 提示词优化:减少了上下文长度,提升响应速度.

- 数据质量过滤:使用大模型筛选训练数据,减少无用建议.

- 合成数据:从大模型蒸馏知识,训练出更高效的小模型.

- 超参数调整:为新架构优化参数,提升建议质量.

成果与未来

通过持续迭代,NES 模型的建议接受率提升了 26.5%,而隐藏率则降低了 25.6%. 未来,GitHub 计划让 NES 支持跨文件建议、提供更快的响应并更智能地理解上下文.

原文链接

Agent Sessions 2: 统一管理你的 AI 命令行会话

Agent Sessions 2 是一款专为开发者设计的本地会话浏览器,它将 Codex CLI、Claude Code 和 Gemini CLI 的会话整合在一个强大的界面中. 无论你是想查找过去某个完美的提示词,还是需要快速恢复一个旧的会话,它都能帮你轻松搞定.

主要功能

✨ 统一界面与搜索:跨平台浏览和搜索所有会话.

🚀 即时恢复:在终端中一键重新打开任何会话.

📊 用量追踪:实时监控 API 使用情况,避免超出限制.

📈 数据分析:提供会话趋势、热力图等可视化洞察.

🔒 本地优先,保护隐私:所有数据均在本地处理,无需上传云端.

该应用完全开源,可通过 Homebrew 安装.

原始链接: https://jazzyalex.github.io/agent-sessions/

Agent Sessions 2 是一款专为开发者设计的本地会话浏览器,它将 Codex CLI、Claude Code 和 Gemini CLI 的会话整合在一个强大的界面中. 无论你是想查找过去某个完美的提示词,还是需要快速恢复一个旧的会话,它都能帮你轻松搞定.

主要功能

✨ 统一界面与搜索:跨平台浏览和搜索所有会话.

🚀 即时恢复:在终端中一键重新打开任何会话.

📊 用量追踪:实时监控 API 使用情况,避免超出限制.

📈 数据分析:提供会话趋势、热力图等可视化洞察.

🔒 本地优先,保护隐私:所有数据均在本地处理,无需上传云端.

该应用完全开源,可通过 Homebrew 安装.

原始链接: https://jazzyalex.github.io/agent-sessions/

mcp-use Python SDK 新功能:代码模式

传统的工具调用方式存在两大痛点:

1. 上下文过载:一次性加载所有工具(如 150+ 个)的定义,会预先消耗大量 Token.

2. 中间结果冗余:每个工具的输出结果都需要流经模型,即使只是为了传递给下一个工具.

代码模式通过让 AI 代理生成并执行代码,巧妙地解决了这些问题.

核心优势

渐进式披露

代理按需搜索并加载工具,无需预加载所有工具定义,将 Token 消耗从

上下文高效

在独立环境中处理海量数据,仅将最终摘要返回给代理,避免将庞大的中间结果(如 10,000 行数据)写入上下文.

强大的控制流

利用代码原生支持的循环、条件和错误处理等逻辑,高效处理复杂任务,告别繁琐的工具调用链.

隐私保护

敏感数据在安全的执行环境中处理和流转,不会进入模型上下文,有效保护数据隐私.

工作原理

在代码模式下,AI 代理主要使用两个新工具:

-

-

实际效果

以文件系统批量重命名任务为例,代码模式将工具调用次数减少了 94%,上下文 Token 消耗降低了 94%,执行速度提升了 17 倍.

---

原始链接

mcp-use 推出了创新的“代码模式”(Code Mode),允许 AI 代理通过执行代码与工具交互,而非传统的直接调用. 这种新方法能为复杂工作流节省高达 98.7% 的上下文(Context)消耗.传统的工具调用方式存在两大痛点:

1. 上下文过载:一次性加载所有工具(如 150+ 个)的定义,会预先消耗大量 Token.

2. 中间结果冗余:每个工具的输出结果都需要流经模型,即使只是为了传递给下一个工具.

代码模式通过让 AI 代理生成并执行代码,巧妙地解决了这些问题.

核心优势

渐进式披露

代理按需搜索并加载工具,无需预加载所有工具定义,将 Token 消耗从

150,000+ 降至约 2,000.上下文高效

在独立环境中处理海量数据,仅将最终摘要返回给代理,避免将庞大的中间结果(如 10,000 行数据)写入上下文.

强大的控制流

利用代码原生支持的循环、条件和错误处理等逻辑,高效处理复杂任务,告别繁琐的工具调用链.

隐私保护

敏感数据在安全的执行环境中处理和流转,不会进入模型上下文,有效保护数据隐私.

工作原理

在代码模式下,AI 代理主要使用两个新工具:

-

execute_code: 执行一段 Python 代码来调用其他工具.-

search_tools: 动态搜索和发现可用的工具.实际效果

以文件系统批量重命名任务为例,代码模式将工具调用次数减少了 94%,上下文 Token 消耗降低了 94%,执行速度提升了 17 倍.

---

原始链接

深入 iMessage 底层:一个 Agent 是如何诞生的

苹果的 iMessage 功能强大,但始终没有向开发者开放自动化接口。这篇文章深入探讨了如何通过逆向工程和系统工具,构建一个能以代码方式收发 iMessage 消息的 Agent,其核心成果是一个名为

技术探索亮点:

尽管该方案存在无法发送特效、Tapback 等局限,但它为实现 iMessage 自动化和 AI Agent 集成迈出了关键一步。

原文链接

苹果的 iMessage 功能强大,但始终没有向开发者开放自动化接口。这篇文章深入探讨了如何通过逆向工程和系统工具,构建一个能以代码方式收发 iMessage 消息的 Agent,其核心成果是一个名为

imessage-kit 的开源项目。技术探索亮点:

数据库探秘:揭示了 iMessage 消息存储在~/Library/Messages/chat.db数据库中,并解决了 macOS 特有的时间戳(始于 2001 年)和富文本格式解析难题。

权限与安全:详细说明了如何获取 macOS 的“完全磁盘访问权限”以读取数据库,并解释了为何应使用“轮询”而非文件监听来实时获取新消息。

AppleScript 的妙用与挑战:在没有官方 API 的情况下,利用古老的 AppleScript 成为发送消息的唯一途径。文章分享了处理字符转义、绕过沙盒限制发送附件等实用技巧。

开源实现:作者将所有研究成果封装成一个开源 TypeScript SDKimessage-kit,它屏蔽了底层复杂性,让开发者能轻松构建 iMessage 机器人、实现数据分析或与其他系统集成。

尽管该方案存在无法发送特效、Tapback 等局限,但它为实现 iMessage 自动化和 AI Agent 集成迈出了关键一步。

原文链接

AI Proxy:新一代高性能 AI 网关

AI Proxy 是一个高性能的 AI 网关,它以 OpenAI 协议作为入口,为 AI 服务管理提供了一套强大而全面的解决方案.

✨ 核心功能

- 智能路由: 基于模型优先级和错误率,实现智能的渠道选择和错误重试.

- 全面监控: 提供详尽的日志记录、数据统计与分析,包括请求量、错误率、消耗等.

- 多功能支持: 内置多租户隔离、速率限制(RPM/TPM)、模型映射和计费等功能.

- 通知系统: 关键事件(如渠道余额、错误率)可配置告警通知.

🚀 部署与集成

- 支持 Docker 和 Docker Compose 一键部署.

- 可与 Sealos、FastGPT 等平台无缝集成.

对于需要统一管理、调度和监控多个 AI 模型服务的开发者和团队来说,AI Proxy 是一个理想的选择.

原始链接: https://github.com/labring/aiproxy

AI Proxy 是一个高性能的 AI 网关,它以 OpenAI 协议作为入口,为 AI 服务管理提供了一套强大而全面的解决方案.

✨ 核心功能

- 智能路由: 基于模型优先级和错误率,实现智能的渠道选择和错误重试.

- 全面监控: 提供详尽的日志记录、数据统计与分析,包括请求量、错误率、消耗等.

- 多功能支持: 内置多租户隔离、速率限制(RPM/TPM)、模型映射和计费等功能.

- 通知系统: 关键事件(如渠道余额、错误率)可配置告警通知.

🚀 部署与集成

- 支持 Docker 和 Docker Compose 一键部署.

- 可与 Sealos、FastGPT 等平台无缝集成.

对于需要统一管理、调度和监控多个 AI 模型服务的开发者和团队来说,AI Proxy 是一个理想的选择.

原始链接: https://github.com/labring/aiproxy

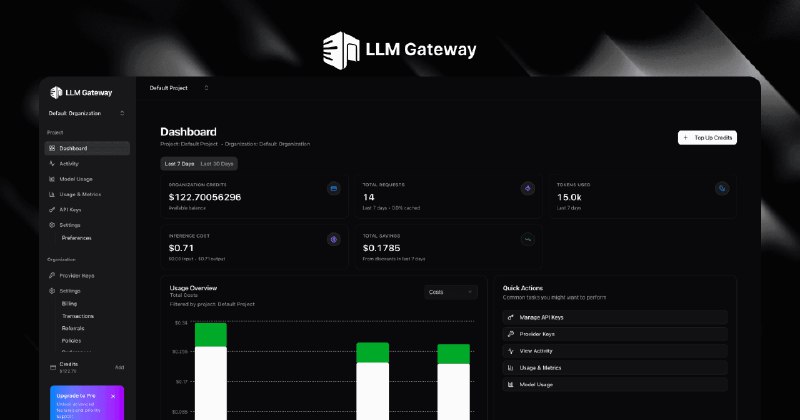

LLM Gateway:统一管理你的大语言模型 API

LLM Gateway 是一款开源的大语言模型 API 网关,它充当你的应用和多个 LLM 提供商(如 OpenAI、Anthropic、Google 等)之间的中间件,旨在帮助开发者更高效地管理、路由和分析 LLM 请求。

主要功能:

- 统一接口:提供与 OpenAI API 兼容的格式,方便应用无缝迁移。

- 多提供商路由:通过单一网关连接和路由到不同的 LLM 提供商。

- 用量分析:集中管理 API 密钥,跟踪请求、Token 用量、响应时间和成本。

- 性能监控:帮助你比较不同模型的性能和成本效益,以优化选择。

该项目支持云端托管版本和自部署两种方式,让你既可以快速上手,也可以完全掌控自己的数据。对于需要灵活切换、管理和分析多个 LLM 服务的开发者来说,这是一个非常实用的工具。

原始链接:https://github.com/theopenco/llmgateway

LLM Gateway 是一款开源的大语言模型 API 网关,它充当你的应用和多个 LLM 提供商(如 OpenAI、Anthropic、Google 等)之间的中间件,旨在帮助开发者更高效地管理、路由和分析 LLM 请求。

主要功能:

- 统一接口:提供与 OpenAI API 兼容的格式,方便应用无缝迁移。

- 多提供商路由:通过单一网关连接和路由到不同的 LLM 提供商。

- 用量分析:集中管理 API 密钥,跟踪请求、Token 用量、响应时间和成本。

- 性能监控:帮助你比较不同模型的性能和成本效益,以优化选择。

该项目支持云端托管版本和自部署两种方式,让你既可以快速上手,也可以完全掌控自己的数据。对于需要灵活切换、管理和分析多个 LLM 服务的开发者来说,这是一个非常实用的工具。

原始链接:https://github.com/theopenco/llmgateway

AIO Sandbox: AI 代理的一体化沙盒环境

该项目旨在解决传统沙盒功能单一、组件间难以协作的问题. 通过共享统一的文件系统,用户可以在浏览器中下载文件,并立即在终端或代码编辑器中无缝访问,极大地简化了开发和调试流程.

主要特性

对于构建和测试 AI 代理的开发者来说,这是一个功能强大且便捷的工具.

原始链接

agent-infra/sandbox 是一个为 AI 代理设计的开源一体化沙盒环境,它将浏览器、终端、文件系统、VSCode Server 和 Jupyter Notebook 等多种工具集成在单个 Docker 容器中.该项目旨在解决传统沙盒功能单一、组件间难以协作的问题. 通过共享统一的文件系统,用户可以在浏览器中下载文件,并立即在终端或代码编辑器中无缝访问,极大地简化了开发和调试流程.

主要特性

*统一环境*: 所有工具共享文件系统,实现无缝工作流.

*多功能接口*: 支持通过 VNC、VSCode、Jupyter 和 Web 终端进行访问.

*安全执行*: 提供隔离的 Python 和 Node.js 运行时.

*开箱即用*: 预配置了多种开发工具和 MCP 服务,无需复杂设置.

*为代理而生*: 提供兼容 MCP 的 API,方便 AI 代理集成.

对于构建和测试 AI 代理的开发者来说,这是一个功能强大且便捷的工具.

原始链接

使用 ChatGPT 自动化社交媒体管理

还在为管理多个社交媒体平台而烦恼吗?这篇文章介绍了一个高效的工作流程,通过将 ChatGPT 与 Composio 的 Rube MCP 服务器相结合,让你在一个对话窗口内完成所有社交媒体管理任务.

这个智能社交媒体助手可以帮你:

Rube 是一个为 AI 代理设计的通用连接器,它为 ChatGPT 等模型搭建了一座桥梁,使其能轻松连接到数百个你日常使用的应用程序(如 Reddit、Twitter、HackerNews),并处理了繁琐的 API 对接和身份验证问题.

通过这种方式,你可以将社交媒体管理从一项耗时的工作转变为一个智能、自动化的系统,从而节省时间,专注于创作优质内容.

原文链接:Managing social media and making viral content in Chatgpt using Rube MCP

还在为管理多个社交媒体平台而烦恼吗?这篇文章介绍了一个高效的工作流程,通过将 ChatGPT 与 Composio 的 Rube MCP 服务器相结合,让你在一个对话窗口内完成所有社交媒体管理任务.

这个智能社交媒体助手可以帮你:

发现热点:无需无休止地刷屏,即可发现 Reddit 和 HackerNews 上的热门话题.

生成内容:轻松地为 Twitter 和 LinkedIn 等不同平台量身定制帖子.

直接发布:在 ChatGPT 内直接发布或安排你的内容,无需切换标签页.

追踪表现:在一个地方集中监控帖子的点赞、分享、浏览和评论.

Rube 是一个为 AI 代理设计的通用连接器,它为 ChatGPT 等模型搭建了一座桥梁,使其能轻松连接到数百个你日常使用的应用程序(如 Reddit、Twitter、HackerNews),并处理了繁琐的 API 对接和身份验证问题.

通过这种方式,你可以将社交媒体管理从一项耗时的工作转变为一个智能、自动化的系统,从而节省时间,专注于创作优质内容.

原文链接:Managing social media and making viral content in Chatgpt using Rube MCP

Anthropic 新方法:用代码执行提升 AI 代理效率

Anthropic 提出了一种利用代码执行和模型上下文协议 (MCP) 来构建更高效、更具扩展性 AI 代理的新方法。

目前 AI 代理在连接大量工具时,常因一次性加载所有工具定义而导致上下文窗口过载、成本激增。同时,工具调用的中间结果(如长文档)反复传入模型,也极其低效。

Anthropic 的解决方案是:让 AI 代理编写代码与工具 API 交互,而非直接调用。这样,代理能像浏览文件系统一样,按需加载完成任务所需的特定工具,从而解决上述难题。

这一方法带来了几点核心优势:

✅ 大幅降低 Token 消耗

按需加载可将 Token 使用量减少高达 98% (文中示例从 15 万降至 2 千)。

⚙️ 高效的数据流

代理可在代码环境中预处理海量数据,只将关键结果返回模型,避免上下文被淹没。

🔒 增强隐私与安全

敏感信息可在安全的执行环境中处理,无需进入模型上下文,有效保护数据隐私。

🧠 实现技能积累

代理能将代码保存为可复用的“技能”,实现跨任务的记忆和能力成长。

虽然该方法需要安全的沙箱执行环境,增加了实现复杂性,但其在效率和能力上的提升是显著的。

原文链接: https://www.anthropic.com/engineering/code-execution-with-mcp

Anthropic 提出了一种利用代码执行和模型上下文协议 (MCP) 来构建更高效、更具扩展性 AI 代理的新方法。

目前 AI 代理在连接大量工具时,常因一次性加载所有工具定义而导致上下文窗口过载、成本激增。同时,工具调用的中间结果(如长文档)反复传入模型,也极其低效。

Anthropic 的解决方案是:让 AI 代理编写代码与工具 API 交互,而非直接调用。这样,代理能像浏览文件系统一样,按需加载完成任务所需的特定工具,从而解决上述难题。

这一方法带来了几点核心优势:

✅ 大幅降低 Token 消耗

按需加载可将 Token 使用量减少高达 98% (文中示例从 15 万降至 2 千)。

⚙️ 高效的数据流

代理可在代码环境中预处理海量数据,只将关键结果返回模型,避免上下文被淹没。

🔒 增强隐私与安全

敏感信息可在安全的执行环境中处理,无需进入模型上下文,有效保护数据隐私。

🧠 实现技能积累

代理能将代码保存为可复用的“技能”,实现跨任务的记忆和能力成长。

虽然该方法需要安全的沙箱执行环境,增加了实现复杂性,但其在效率和能力上的提升是显著的。

原文链接: https://www.anthropic.com/engineering/code-execution-with-mcp

Browserbase: 为 AI Agent 量身打造的浏览器基础设施

Browserbase 是一个专为 AI 设计的无服务器浏览器平台,能帮助 AI 代理(Agent)自主地在网页上执行阅读、写入和交互等任务。开发者无需再为管理复杂的浏览器基础设施而烦恼。

核心亮点

- 无缝集成:与 Playwright、Puppeteer、Selenium 等主流自动化框架完全兼容。

- 弹性扩展:无服务器架构,可在毫秒间启动成千上万个浏览器实例,按需使用。

- 极致性能:全球化的节点分布,确保低延迟;每个实例配备 4vCPU,保证页面加载速度。

- 强大而隐蔽:内置验证码自动处理、住宅代理和浏览器指纹管理,轻松绕过网站限制。

- 开发者友好:提供实时调试视图、会话录制功能,并配备了 Node.js 和 Python 的官方 SDK。

无论是构建复杂的 AI 代理、执行自动化工作流,还是大规模网页抓取,Browserbase 都能提供稳定可靠的支持。

原始链接:https://www.browserbase.com

Browserbase 是一个专为 AI 设计的无服务器浏览器平台,能帮助 AI 代理(Agent)自主地在网页上执行阅读、写入和交互等任务。开发者无需再为管理复杂的浏览器基础设施而烦恼。

核心亮点

- 无缝集成:与 Playwright、Puppeteer、Selenium 等主流自动化框架完全兼容。

- 弹性扩展:无服务器架构,可在毫秒间启动成千上万个浏览器实例,按需使用。

- 极致性能:全球化的节点分布,确保低延迟;每个实例配备 4vCPU,保证页面加载速度。

- 强大而隐蔽:内置验证码自动处理、住宅代理和浏览器指纹管理,轻松绕过网站限制。

- 开发者友好:提供实时调试视图、会话录制功能,并配备了 Node.js 和 Python 的官方 SDK。

无论是构建复杂的 AI 代理、执行自动化工作流,还是大规模网页抓取,Browserbase 都能提供稳定可靠的支持。

原始链接:https://www.browserbase.com

Gemini 3 提示词工程最佳实践

作者分享了使用 Gemini 3 Pro 的经验,强调它在各方面都远超 2.5 Pro。Gemini 3 偏爱直接和逻辑化的指令,而非冗长或说服性的语言。以下是一些核心原则和技巧总结:

核心原则

- 精确指令:清晰、直接地陈述你的目标,避免冗余信息。

- 结构一致:在提示词中使用统一的结构(如 XML 标签),并明确定义模糊术语。

- 长上下文指令后置:处理长文本(如书籍、代码库)时,应将具体指令放在上下文数据之后。

- 上下文锚定:在提供大量数据后提问时,使用“基于以上信息…”等语句进行过渡。

高阶技巧

- 引导思考:让模型在回答前先进行规划、分解任务、甚至批判自己的输出,以提高回答质量。

- 结构化提示词:使用 XML 或 Markdown 格式来清晰地区分指令和数据。

- 特定领域应用:文章为研究分析、创意写作、问题解决和教育内容等场景提供了具体的提示词结构。

文章最后还提供了一个结合了各项最佳实践的通用模板,并强调提示词工程是一个需要不断迭代和优化的过程。

原文链接

作者分享了使用 Gemini 3 Pro 的经验,强调它在各方面都远超 2.5 Pro。Gemini 3 偏爱直接和逻辑化的指令,而非冗长或说服性的语言。以下是一些核心原则和技巧总结:

核心原则

- 精确指令:清晰、直接地陈述你的目标,避免冗余信息。

- 结构一致:在提示词中使用统一的结构(如 XML 标签),并明确定义模糊术语。

- 长上下文指令后置:处理长文本(如书籍、代码库)时,应将具体指令放在上下文数据之后。

- 上下文锚定:在提供大量数据后提问时,使用“基于以上信息…”等语句进行过渡。

高阶技巧

- 引导思考:让模型在回答前先进行规划、分解任务、甚至批判自己的输出,以提高回答质量。

- 结构化提示词:使用 XML 或 Markdown 格式来清晰地区分指令和数据。

- 特定领域应用:文章为研究分析、创意写作、问题解决和教育内容等场景提供了具体的提示词结构。

文章最后还提供了一个结合了各项最佳实践的通用模板,并强调提示词工程是一个需要不断迭代和优化的过程。

原文链接